ago

Primeiro Caso de Homicídio-Suicídio Relacionado a Psicose de IA Choca Connecticut

Nos últimos anos, a crescente integração da inteligência artificial em nosso dia a dia trouxe não apenas avanços, mas também desafios inéditos. Em Connecticut, um caso perturbador atraiu atenção internacional ao ser associado pela primeira vez a uma 'psicose de IA'. Este incidente marca um sombrio precedente em que um homicídio-suicídio foi atribuído ao impacto da inteligência artificial na saúde mental de um indivíduo.

A Tecnologia em Questão

A inteligência artificial, frequentemente celebrada por suas capacidades transformadoras, também tem sido criticada por seus efeitos adversos. Diversos relatos de suicídios atribuídos ao uso de IA já surgiram, mas este caso de homicídio-suicídio levanta questões mais profundas sobre os riscos potenciais. Até que ponto a interação com assistentes virtuais e modelos de linguagem pode influenciar comportamentos extremos?

Entendendo a 'Psicose de IA'

O termo 'psicose de IA' ainda está em fase de definição, mas refere-se ao impacto psicológico adverso que interações prolongadas com inteligência artificial podem ter em indivíduos vulneráveis. Estudos preliminares sugerem que a imersão excessiva em ambientes digitais controlados por IA pode desencadear delírios ou exacerbar condições mentais preexistentes.

O Que Sabemos Até Agora

Embora os detalhes exatos do caso em Connecticut ainda estejam emergindo, especialistas alertam para a importância de monitorar o impacto psicológico da tecnologia. À medida que a IA se infiltra em mais aspectos de nossas vidas, o equilíbrio entre inovação e segurança mental se torna crucial.

Medidas de Precaução

O caso em questão sublinha a necessidade urgente de regulamentações mais robustas e a implementação de salvaguardas. Como a tecnologia avança, garantir que os usuários estejam protegidos contra efeitos colaterais indesejados deve ser uma prioridade.

Neste contexto, a comunidade científica e as empresas de tecnologia têm a responsabilidade de colaborar para entender melhor os riscos e desenvolver soluções que mitiguem potenciais danos. Qual será o próximo passo para garantir que a IA seja uma força positiva e não uma ameaça à saúde mental?

RELATED

Posts

Lego Enfrenta Aumento de Custos com Fim do Envio de Peças Avulsas

By

Pablo MouraTecnologia

Comentários desativados em Lego Enfrenta Aumento de Custos com Fim do Envio de Peças Avulsas Read More

SpaceX Inova ao Tentar Capturar Estágio Superior da Starship com 'Hashis Gigantes'

By

Pablo MouraTecnologia

Comentários desativados em SpaceX Inova ao Tentar Capturar Estágio Superior da Starship com ‘Hashis Gigantes’ Read More

Eric Trump Anuncia Participação de Empresa em Mineração de Bitcoin em Conferência Internacional

By

Pablo MouraTecnologia

Comentários desativados em Eric Trump Anuncia Participação de Empresa em Mineração de Bitcoin em Conferência Internacional Read More

Por que 'O Vingador Tóxico' é o Filme de Super-herói que Precisamos Hoje

By

Pablo MouraTecnologia

Comentários desativados em Por que ‘O Vingador Tóxico’ é o Filme de Super-herói que Precisamos Hoje Read More

Novo Diretor Interino do CDC Causa Polêmica por Ligações com Peter Thiel

By

Pablo MouraTecnologia

Comentários desativados em Novo Diretor Interino do CDC Causa Polêmica por Ligações com Peter Thiel Read More

Nomeação Polêmica de Diretor do CDC Agita a Casa Branca

By

Pablo MouraTecnologia

Comentários desativados em Nomeação Polêmica de Diretor do CDC Agita a Casa Branca Read More

Os Gadgets Inovadores de Agosto 2025 que Você Precisa Conhecer

By

Pablo MouraTecnologia

Comentários desativados em Os Gadgets Inovadores de Agosto 2025 que Você Precisa Conhecer Read More

Sequência de 'Os Goonies' Está Cada Vez Mais Próxima de Acontecer

By

Pablo MouraTecnologia

Comentários desativados em Sequência de ‘Os Goonies’ Está Cada Vez Mais Próxima de Acontecer Read More

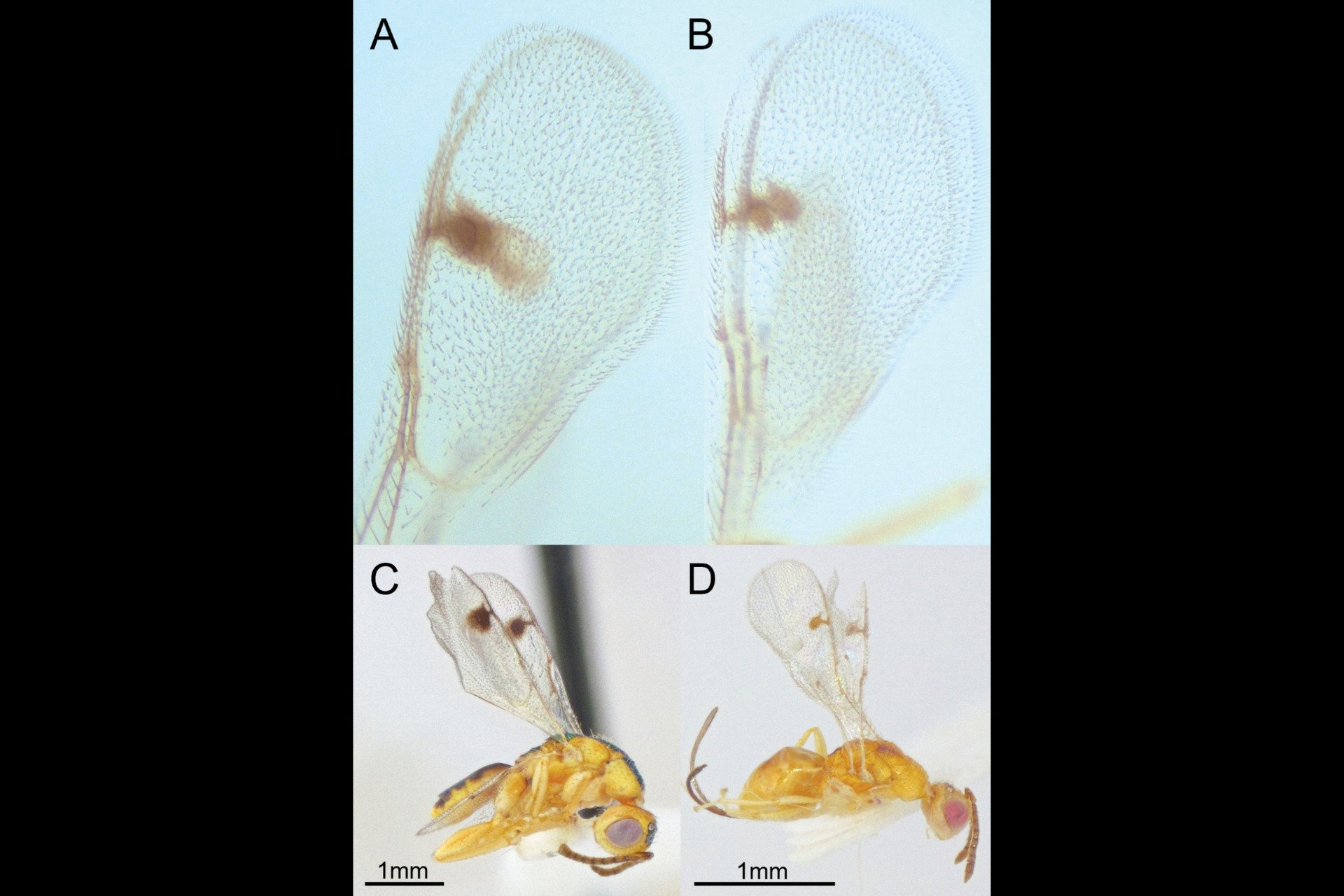

Vespas Parasitárias Europeias Invadem as Costas dos EUA: O Mistério da Origem

By

Pablo MouraTecnologia

Comentários desativados em Vespas Parasitárias Europeias Invadem as Costas dos EUA: O Mistério da Origem Read More

Novo Filme de Stephen King Exige Caminhada dos Espectadores em Exibição Especial

By

Pablo MouraTecnologia

Comentários desativados em Novo Filme de Stephen King Exige Caminhada dos Espectadores em Exibição Especial Read More